随着人工智能(AI)技术的飞速发展,其在军事领域的应用日益广泛。美国作为全球科技领先国家,正大力开发军事自主系统,旨在提升作战效率和战略优势。这些系统的快速发展也引发了一系列隐患,值得深入探讨。

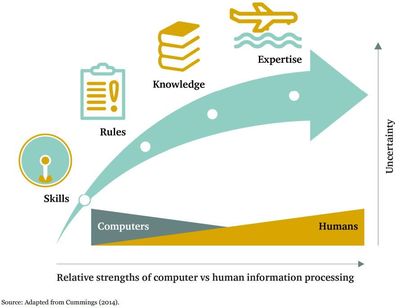

美军自主系统依赖先进的计算机信息技术,包括机器学习、传感器网络和数据分析。这些技术能够实现自主决策、目标识别和战术执行,减少人为干预,提高反应速度。例如,无人机和自主武器系统可在复杂环境中执行任务,降低士兵风险。

开发这些系统带来了诸多隐患。一是伦理问题:自主系统可能缺乏人类判断力,导致误伤平民或违反国际法。例如,AI决策算法若出现偏差,可能引发不可控的军事冲突。二是安全风险:系统易受网络攻击,黑客入侵可能篡改指令,造成灾难性后果。美军的测试显示,某些自主系统在面对复杂环境时,容易产生意外行为。

技术依赖可能导致军事过度自动化,削弱士兵的技能和决策能力。长期来看,这可能影响军事人员的训练和士气。同时,自主系统的开发成本高昂,占用大量资源,若未能有效整合,可能造成浪费。

国际社会对军事AI的监管尚不完善,美国在推进自主系统时,需平衡创新与风险。专家呼吁加强国际合作,建立伦理框架,确保技术发展不危及全球安全。

美军在AI与未来战争中的自主系统开发,虽具潜力,但隐患重重。通过加强技术测试、伦理审查和国际对话,才能迈向更安全的军事未来。